Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

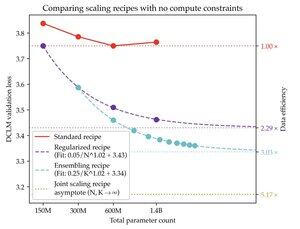

Предварительное обучение с бесконечными вычислениями

• Данные, а не вычисления, являются новым узким местом

• Стандартные рецепты переобучаются → исправить с помощью сильной регуляризации (30× уменьшение веса)

• Законы масштабирования: потеря уменьшается монотонно, лучше всего измеряется асимптотой, а не фиксированным бюджетом

Топ

Рейтинг

Избранное