Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Jos luet yhden asian tällä viikolla, ehdottaisit alla olevaa tekoälyraporttia:

"Datavalimoista maailmanmalleihin"

Se kietoo yhteen datavalimot, kontekstisuunnittelun, RL-ympäristöt, maailmanmallit ja paljon muuta helposti lähestyttäväksi, mutta kattavaksi esseeksi tekoälyn nykyisestä reunasta.👇(0/12)

Koko artikkeli:

🧵alla:

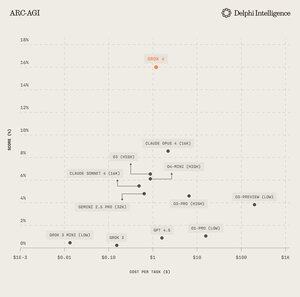

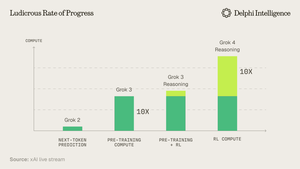

1) Grok 4 -julkaisusta lähtien on selvää, ettemme ole törmänneet "seinään" laskentakuluissa.

Lähde: @xai

2) Yhä useammin data näyttää olevan teltan lyhyt tanko.

Lähde: @EpochAIResearch

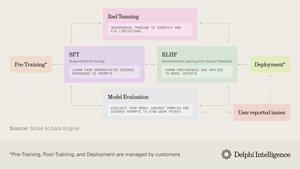

3) Suurin osa näistä menoista menee korkealaatuisten tietojoukkojen luomiseen koulutuksen jälkeistä käyttöä varten, mikä lähestyy nopeasti 50 prosenttia laskentabudjeteista

4) Tämä on johtanut kysynnän kasvuun "datavalimoille", kuten @scale_AI @HelloSurgeAI @mercor_ai ja muille, jotka auttavat hankkimaan tarvittavaa asiantuntemusta ja luomaan RL:lle välttämättömiä dataputkia ei-todennettavilla alueilla...

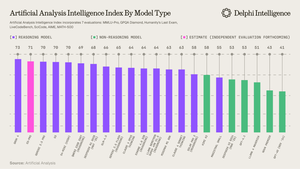

5) Mikä voi auttaa ruokkimaan yhä tehokkaampia päättelymalleja, selvästi skaalausparadigma du jour per @ArtificialAnlys

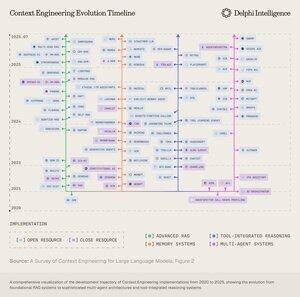

6) Ja silti malleja ei enää rajoita älykkyysosamäärä vaan konteksti. Nopea suunnittelu on siirtänyt viestikapulan "Context Engineeringille" - kasvavalle alalle, joka optimoi tiedon hyötykuormia LLM:ille.

7) Tila on erittäin dynaaminen, mutta yleensä siihen liittyy kontekstin skaalaaminen 2 vektorin kesken:

1. Kontekstin pituus: ultrapitkien sekvenssien käsittelyn laskennalliset ja arkkitehtoniset haasteet

2. Multimodaalinen: kontekstin skaalaaminen tekstin ulkopuolelle aidosti multimodaalisiin ympäristöihin.

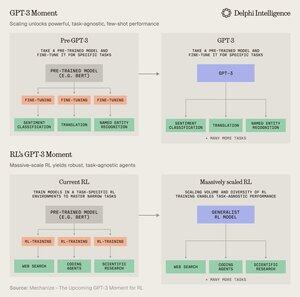

8) Ehkä kontekstin lopullinen ilmaisu on luoda "RL-ympäristöjä", jotka jäljittelevät täydellisesti tehtäviä, joissa RL:ää voidaan suorittaa.

Vaikka tiedot ovat nykyään rajallisia, @MechanizeWork uskoo, että olemme menossa kohti "GPT-3-tyyppistä" taivutusta, jossa on massiivisesti skaalautuva RL

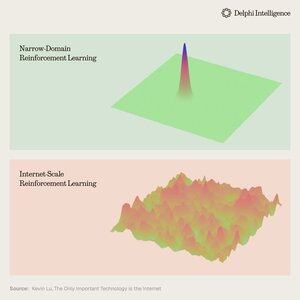

9) Näiden ympäristöjen luominen on kuitenkin melko työlästä, eikä se vaikuta kovin "katkeralta oppituntipilleriltä".

@_kevinlu ihmettelee, onko olemassa tapaa valjastaa internet harjoittelun jälkeiseen harjoitteluun, kuten tehtiin esikoulutuksessa?

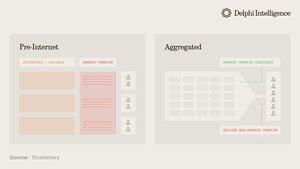

10) Vaikka ajatus on mielenkiintoinen, suuri osa internetistä on vallattu muutamaan suureen ekosysteemiin, jotka ovat vertikaalisesti integroituneita ja johtavat nopeasti RL:ää ainesosiensa yli entistä nopeamman RL:n saavuttamiseksi

(eli alfa kehittyy @GoogleDeepMind )

11) On epäselvää, pitävätkö nämä suuret yritykset erilaisia RL-ympäristöjä välttämättöminä vai vain väliaikaisena pysäkkinä matkalla kohti täysiä "maailmanmalleja", joissa on lähes kaikkien ilmiöiden digitaaliset kaksoset

Googlen Genie 3 on varmasti nyökkäys tähän suuntaan:

5.8.2025

What if you could not only watch a generated video, but explore it too? 🌐

Genie 3 is our groundbreaking world model that creates interactive, playable environments from a single text prompt.

From photorealistic landscapes to fantasy realms, the possibilities are endless. 🧵

12) Tämä herättää kysymyksen: ovatko vertikaalisesti integroidut lähestymistavat synteettisen älykkyyden rakentamiseen nopeammilla RL-palautesilmukoilla tarkoitettu nopeuttamaan eteenpäin ja valloittamaan markkinoita vai voivatko piilevän laskennan, datan ja lahjakkuuden modulaariset järjestelmät kilpailla tehokkaan orkestroinnin kanssa?

841

Johtavat

Rankkaus

Suosikit