Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Quem inventou as redes neurais convolucionais (CNNs)?

1969: Fukushima tinha ReLUs relevantes para a CNN [2].

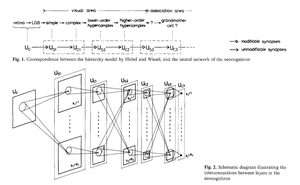

1979: Fukushima tinha a arquitetura básica da CNN com camadas de convolução e camadas de downsampling [1]. A computação era 100 vezes mais cara do que em 1989 e um bilhão de vezes mais cara do que hoje.

1987: Waibel aplicou a retropropagação de Linnainmaa de 1970 [3] a TDNNs de compartilhamento de peso com convoluções unidimensionais [4].

1988: Wei Zhang et al. aplicaram CNNs bidimensionais "modernas" treinadas por backprop ao reconhecimento de caracteres [5].

Todos os itens acima foram publicados no Japão de 1979 a 1988.

1989: LeCun et al. aplicaram CNNs novamente ao reconhecimento de caracteres (códigos postais) [6,10].

1990-93: A redução da amostragem de Fukushima com base na média espacial [1] foi substituída por max-pooling para TDNNs 1-D (Yamaguchi et al.) [7] e CNNs 2-D (Weng et al.) [8].

2011: Muito mais tarde, minha equipe com Dan Ciresan fez o pooling máximo de CNNs muito rápido em GPUs NVIDIA. Em 2011, a DanNet alcançou o primeiro resultado de reconhecimento de padrões sobre-humanos [9]. Por um tempo, desfrutou de um monopólio: de maio de 2011 a setembro de 2012, a DanNet venceu todos os desafios de reconhecimento de imagem em que participou, 4 deles consecutivos. É certo, no entanto, que isso foi principalmente sobre engenharia e ampliação dos insights básicos do milênio anterior, lucrando com hardware muito mais rápido.

Alguns "especialistas em IA" afirmam que "fazer as CNNs funcionarem" (por exemplo, [5,6,9]) foi tão importante quanto inventá-las. Mas "fazê-los funcionar" dependia em grande parte de seu laboratório ser rico o suficiente para comprar os computadores mais recentes necessários para ampliar o trabalho original. É o mesmo que hoje. Pesquisa básica vs engenharia/desenvolvimento - o R vs o D em P&D.

REFERÊNCIAS

[1] K. Fukushima (1979). Modelo de rede neural para um mecanismo de reconhecimento de padrões não afetado pela mudança de posição - Neocognitron. IECE, vol. J62-A, nº 10, pp. 658-665, 1979.

[2] K. Fukushima (1969). Extração de recursos visuais por uma rede multicamadas de elementos de limiar analógicos. Transações IEEE em Ciência de Sistemas e Cibernética. 5 (4): 322-333. Este trabalho introduziu unidades lineares retificadas (ReLUs), agora usadas em muitas CNNs.

[3] S. Linnainmaa (1970). Tese de Mestrado, Univ. Helsinque, 1970. A primeira publicação sobre retropropagação "moderna", também conhecida como modo reverso de diferenciação automática. (Veja a conhecida visão geral da retropropagação de Schmidhuber: "Quem inventou a retropropagação?")

[4] A. Waibel. Reconhecimento de fonemas usando redes neurais de atraso de tempo. Reunião do IEICE, Tóquio, Japão, 1987. Retropropagação para um TDNN de compartilhamento de peso com convoluções 1-dimensionais.

...

Melhores

Classificação

Favoritos