Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Vem uppfann konvolutionella neurala nätverk (CNN)?

1969: Fukushima hade CNN-relevanta ReLU:er [2].

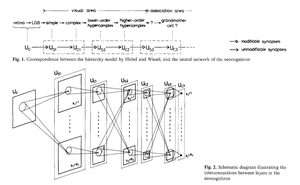

1979: Fukushima hade den grundläggande CNN-arkitekturen med faltningslager och nedsamplingslager [1]. Beräkning var 100 gånger dyrare än 1989 och en miljard gånger dyrare än idag.

1987: Waibel tillämpade Linnainmaas backpropagation från 1970 [3] på viktdelande TDNN:er med 1-dimensionella faltningar [4].

1988: Wei Zhang et al. tillämpade "moderna" backprop-tränade 2-dimensionella CNN:er för teckenigenkänning [5].

Allt ovanstående publicerades i Japan 1979-1988.

1989: LeCun et al. tillämpade CNN igen på teckenigenkänning (postnummer) [6,10].

1990-93: Fukushimas nedsampling baserad på spatial averaging [1] ersattes av max-pooling för 1-D TDNNs (Yamaguchi et al.) [7] och 2D-CNN (Weng et al.) [8].

2011: Långt senare gjorde mitt team med Dan Ciresan max-pooling av CNN:er riktigt snabbt på NVIDIA GPU:er. År 2011 uppnådde DanNet det första resultatet av igenkänning av övermänskliga mönster [9]. Under en tid hade det monopol: från maj 2011 till september 2012 vann DanNet varje bildigenkänningsutmaning som de deltog i, 4 av dem i rad. Visserligen handlade det mest om att konstruera och skala upp de grundläggande insikterna från det förra millenniet och dra nytta av mycket snabbare hårdvara.

Vissa "AI-experter" hävdar att det var lika viktigt att "få CNN att fungera" (t.ex. [5,6,9]) som att uppfinna dem. Men att "få dem att fungera" berodde till stor del på om ditt labb var tillräckligt rikt för att köpa de senaste datorerna som krävdes för att skala upp det ursprungliga arbetet. Det är samma som idag. Grundforskning kontra teknik/utveckling - Forskning vs D inom FoU.

REFERENSER

[1] K. Fukushima (1979). Neural nätverksmodell för en mekanism för mönsterigenkänning som inte påverkas av positionsförskjutning - Neocognitron. IECE, vol. J62-A, nr 10, s. 658-665, 1979.

[2] K. Fukushima (1969). Extrahering av visuella egenskaper av ett flerskiktat nätverk av analoga tröskelelement. IEEE Transactions on Systems Science and Cybernetics. 5 (4): 322-333. Detta arbete introducerade likriktade linjära enheter (ReLUs), som nu används i många CNNs.

[3] S. Linnainmaa (1970). Magisteravhandling, Helsingfors universitet, 1970. Den första publikationen om "modern" backpropagation, även känd som det omvända läget för automatisk differentiering. (Se Schmidhubers välkända översikt över backpropagation: "Who Invented Backpropagation?")

[4] A. Waibel. Fonemigenkänning med hjälp av neurala nätverk med tidsfördröjning. Möte i IEICE, Tokyo, Japan, 1987. Backpropagation för en viktdelande TDNN med 1-dimensionella faltningar.

...

Topp

Rankning

Favoriter